上一期我们聊了OpenClaw这只“龙虾”到底能干什么——能写代码、回邮件、做报表,24小时替你干活。

但说实话,我收到的私信里,80%的人卡在了同一个问题上:这东西到底怎么装?

本地部署坑太多,Token一天烧几百,端口暴露还容易被盗刷。看了一堆教程,跟着操作到一半就报错,然后就开始怀疑人生。

今天我换一种思路——从零开始,用云服务器+大模型API+飞书机器人,四步跑通OpenClaw,让你在手机上就能随时召唤你的AI程序员。

这套方案是我自己踩了无数坑之后沉淀下来的最优解。先记住一句口诀:不要一开始就追求完美,先让龙虾跑起来,看到第一条回复,你就已经超越了80%的人。

⚠️ 动手前必读:三个最大的坑

在敲任何命令之前,你必须理解OpenClaw三个最致命的“烧钱+安全隐患”:

坑一:Token是吞金兽。 OpenClaw每次执行任务都需要调用大模型API,由于需要多轮任务拆解,Token消耗量是普通对话AI的数倍甚至上百倍。更隐蔽的是“心跳机制”——每30分钟自动向模型发送检查请求,24小时后台运行即使一条指令不发,一天也会产生几十次API调用。有人一觉醒来几百块充值金就没了。

坑二:安全隐患不容忽视。 OpenClaw具备系统级操作权限,默认配置不当极易导致远程接管、数据泄露。国家互联网应急中心(CNCERT)已专门发布安全使用指南:不建议在主力办公电脑上安装,不建议用管理员权限运行,不要把默认端口暴露到公网。

坑三:不要试图自己解决所有报错。 遇到问题第一反应不是百度,而是把报错日志复制给ChatGPT,让它帮你分析。这才是AI时代的正确工作方式。

知道了这些坑,我们才能有的放矢。

第一步:买一台云服务器(别用本地电脑)

很多新手第一反应是:“我就在自己电脑上装呗,干嘛花钱买服务器?”

答案是:本地部署是给自己找罪受。

- 网络玄学:调用海外大模型API,科学上网稍微一波动,任务直接中断

- 没法24小时在线:电脑一关机,龙虾就下班

- 环境污染风险:AI自动执行脚本时,一个误操作把你本地文件删了,哭都来不及

云服务器的绝对优势:海外节点直连API不掉线、7×24小时待命、安全沙盒随便折腾大不了重装。

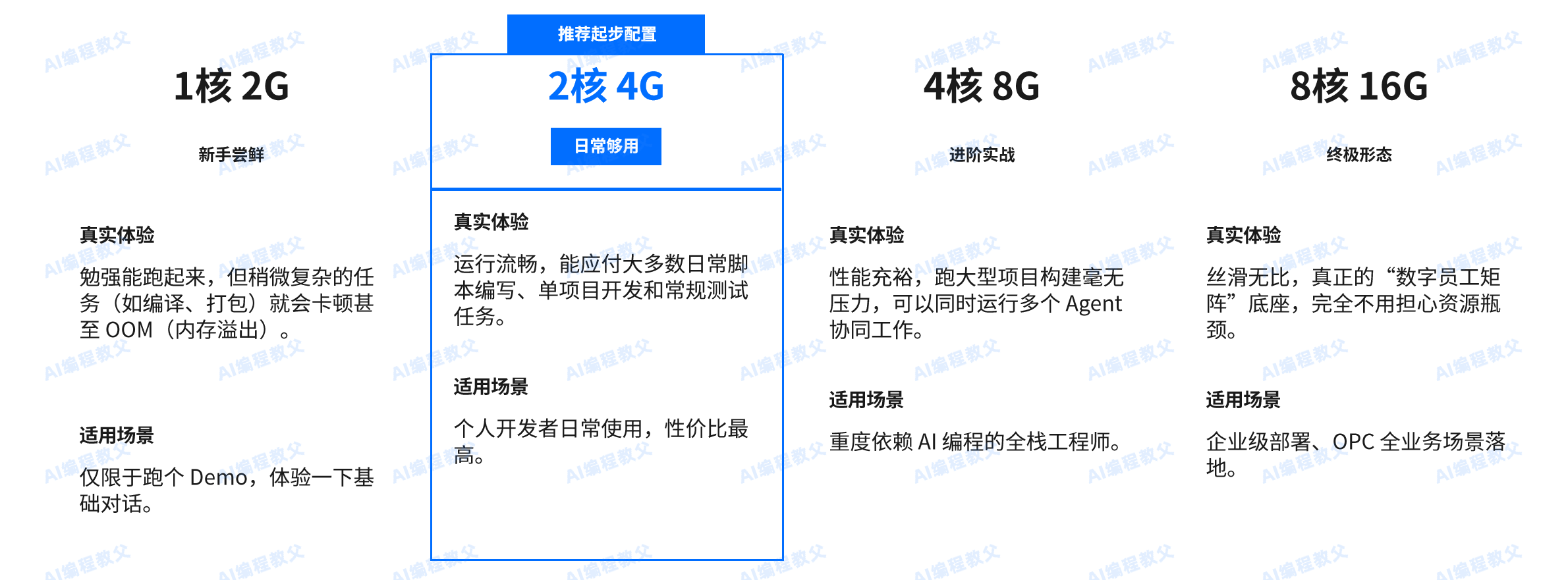

配置怎么选?

避坑忠告:新手直接从2核4G起步。 很多时候你以为AI变笨了,其实是你服务器内存爆了。

国内 vs 海外服务器(关键选择)

- 国内服务器:连SSH快,但调用Claude/OpenAI API需要配代理,网络极不稳定。不推荐。

- 海外服务器(强烈推荐):直连API稳定无延迟。首选硅谷、新加坡节点。

推荐腾讯云或阿里云的轻量应用服务器,选新加坡或硅谷地域,Ubuntu 22.04系统,2核4G配置。

买好后,在云控制台的“防火墙/安全组”里开放以下端口:

- 22:SSH远程连接(必须)

- 80/443:Web服务(必须)

- 3000、5173、8080:前端调试端口

- 8000、8001、9000:后端API调试端口

⚠️ 新手最容易踩的坑: 服务器买好了,服务启动了,但死活访问不了——99%是因为安全组没开放对应端口。但也不要图省事开放“所有端口”,这会让服务器变成黑客的肉鸡。

第二步:一键安装OpenClaw

验证标准:能看到启动成功日志,第二步过。

第三步:接入大模型API(这一步是真正的分水岭)

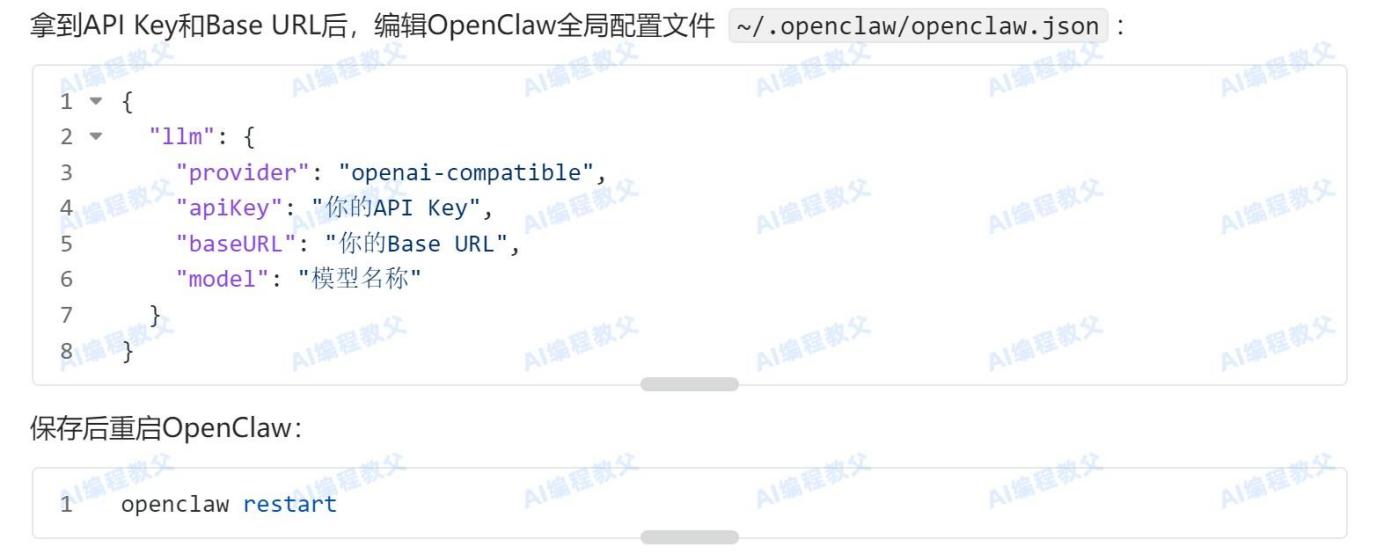

OpenClaw本身免费,但需要接入大模型API才能“动脑子”。这是整个部署过程中最关键也最容易踩坑的一步。

官方直连的痛点

如果你直接去Claude或OpenAI官网申请API,会面临三重门槛:

- 注册门槛高:需要海外手机号、海外信用卡,风控极严极易被封

- 充值极其繁琐:需要折腾虚拟信用卡,手续费高昂且不稳定

- 多模型管理混乱:Claude和OpenAI要分别注册、分别充值、分别管理配额

对于刚入门的新手来说,很可能折腾了半天API还没搞定,热情就已经被消耗殆尽了。

目前的三种通用思路

思路一:申请国内大厂的免费额度

部分国内云厂商(如阿里、智谱等)提供大模型API的免费试用额度,注册即可领取。优点是零成本上手,缺点是额度有限、模型选择受限,且免费版通常有调用频率限制。适合前两周体验,不是长期方案。

思路二:官方API + 自己管理多账号

有一定动手能力的玩家,可以通过多账号轮换的方式摊薄成本。比如在某鱼上找ChatGPT Team账号合租,成本可以压到每月几块钱。但管理起来比较麻烦——多个API Key分散在不同地方,配额用完了要手动切换,容易手忙脚乱。

思路三:使用API聚合服务

这是一种近两年兴起的解决方案:把多个大模型的API统一聚合到一个入口,你只需要一个Key就能调用Claude、GPT、Gemini等所有主流模型。优势是一次充值、统一管理、按量计费无月租,省去了分别注册和分别充值的麻烦。

关于思路三,我后面会专门出一期深度内容——详细拆解这种聚合方案的技术原理、如何自建、以及如何选择靠谱的服务商。今天我们先聚焦在“把龙虾跑起来”这件事上。

本期实战:先用免费额度跑通流程

为了让你今天就能把龙虾跑起来,我建议先用国内大厂的免费API额度完成配置验证。具体申请流程各大平台都有官方文档,这里不赘述。

验证标准: 终端输入 openclaw chat 进入对话模式,发送“你好”收到回复,说明配置成功。

第四步:接入飞书机器人(手机上随时召唤龙虾)

这是让很多人头疼的一环,但也是最值得投入的一环——打通之后,地铁上用手机也能给龙虾派活。

为什么选飞书?

- 多端实时同步:手机、电脑、平板都能用

- 完美富文本支持:代码高亮、Markdown渲染,阅读体验完爆命令行

- 无缝团队协作:可以把AI机器人拉进项目群聊

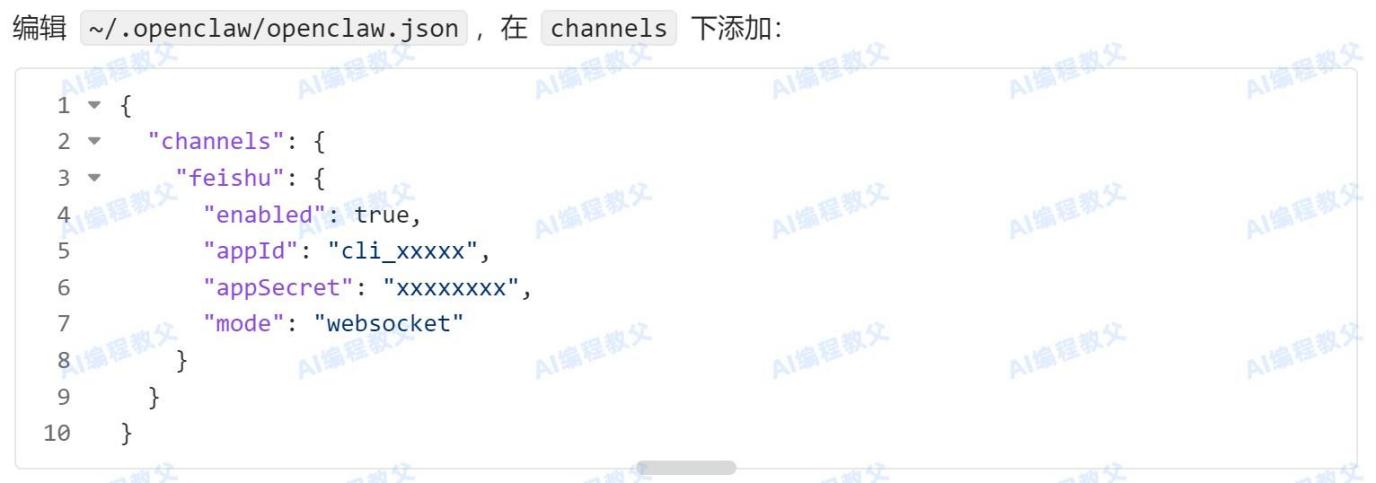

配置流程(WebSocket模式,避开90%的坑)

核心避坑提醒:务必选择WebSocket模式! webhook模式需要公网IP和内网穿透,会让90%的新手直接放弃。

Step 1:创建飞书应用

- 登录飞书开放平台,创建企业自建应用

- 在“凭证与基础信息”页面复制 App ID 和 App Secret

Step 2:配置权限和机器人

- “权限管理”搜索并开通:im:message、im:message:send、im:chat

- “应用能力” → “机器人”,启用机器人功能

Step 3:配置事件订阅(关键!)

- 左侧“事件订阅”,请求网址留空

- 订阅事件添加:im.message.receive_v1

- 连接方式选择“WebSocket”

Step 4:发布应用

点击“创建版本”并发布,企业自建应用通常内部秒批。

Step 5:配置OpenClaw的飞书通道

Step 6:重启并验证

打开飞书App搜索你的机器人,发送“你好”。如果收到回复,恭喜,最小可用路径全链路跑通!

四步之后,你拥有了什么?

一个7×24小时在线、随时通过飞书唤醒、能真正帮你干活的AI编程助理。

接下来你就可以开始真正“用”它了:

- 把接口文档发给它,让它自动生成CRUD代码

- 让它帮你分析服务器日志,定位Bug

- 喂给它项目代码,让它写单元测试

但有一个问题你很快就会遇到:免费额度不够用,多模型管理太麻烦。

这也是我下一期要重点解决的问题。

下一期,我会专门讲“如何低成本搞定大模型API调用”——包括多账号轮换的技巧、API聚合方案的深度拆解,以及一个能让你用最少的钱调用最强模型的方法。

这期内容的价值,可能会帮你省下几百甚至上千块的API费用。建议你一定不要错过。

安装遇到问题?看这里

90%的问题用这三条命令解决:

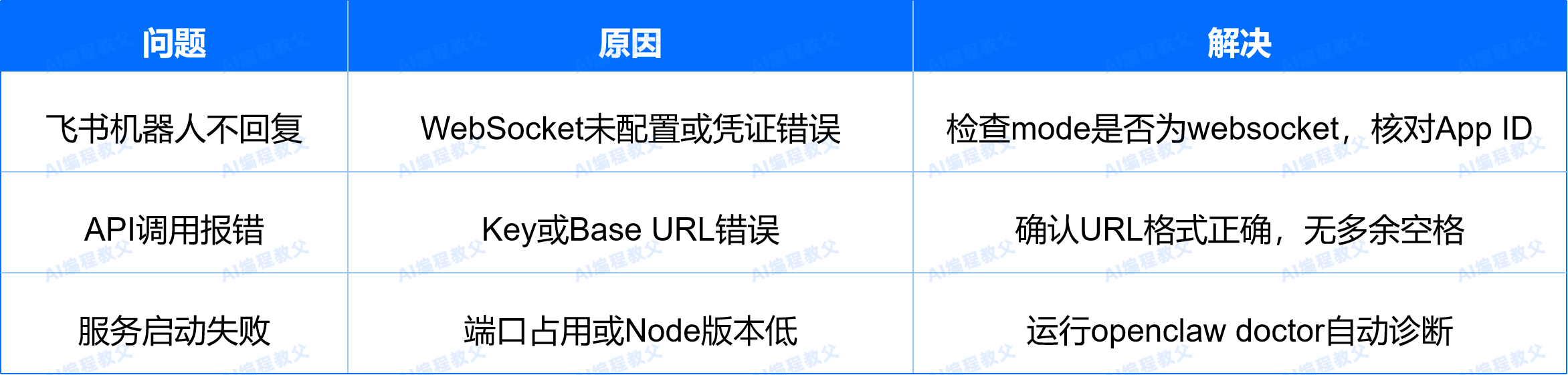

常见问题速查:

评论区聊聊:你的龙虾装好了吗?API这一步卡住没有?留言你的问题,我来帮你排查。

关注我,不走丢。这个时代,要么指挥AI,要么被AI甩下——你想做哪一个?